Apple แถลงว่าจะเลื่อนเปิดใช้ฟีเจอร์กรองเนื้อหาไม่เหมาะสมสำหรับเด็ก (CSAM) ออกไป หลังจากถูกกดดันและคัดค้านจากหลายกลุ่ม

ฟีเจอร์กรองเนื้อหาไม่เหมาะสมสำหรับเด็ก (CSAM)

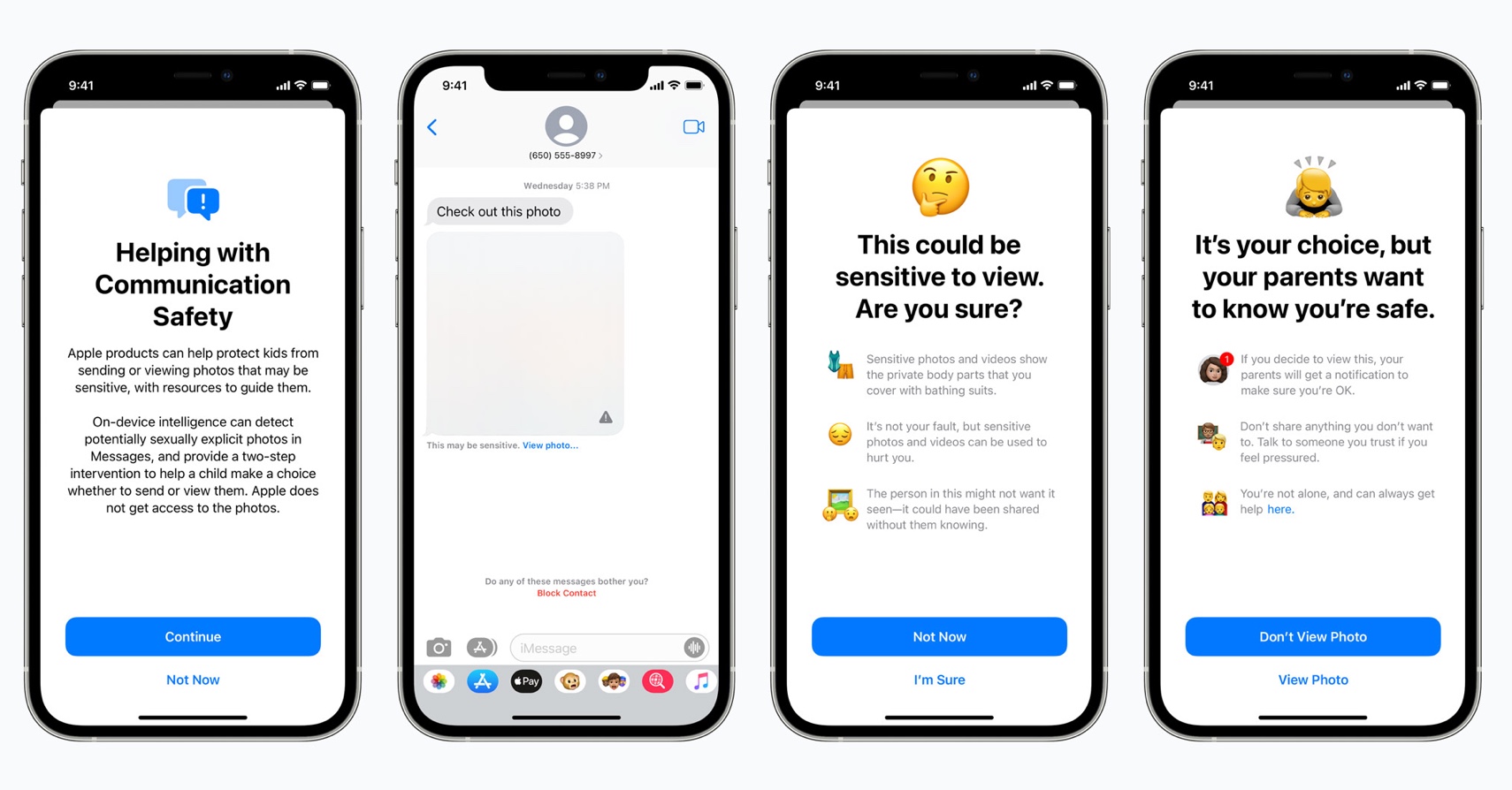

ก่อนหน้านี้ Apple ประกาศเตรียมเปิดใช้ฟีเจอร์กรองเนื้อหาไม่เหมาะสมสำหรับเด็ก เช่น ภาพไม่เหมาะสม โป๊เปลือย ที่ส่งมาในแอป Message โดยฟีเจอร์นี้จะมาใน iOS 15, macOS Monterey เริ่มใช้ในสหรัฐก่อน โดยจะเริ่มเปิดใช้ปลายปี 2021 นี้

หลัง Apple เปิดตัวฟีเจอร์ CSAM ก็ได้รับกระแสต่อต้าน คัดค้าน และไม่เห็นด้วยจากหลาย ๆ กลุ่ม โดยบางกลุ่มมองถึงเรื่องสิทธิส่วนบุคคล ความเป็นส่วนตัวด้วย ถึงขั้นอยากให้ Apple เลิกปล่อยฟีเจอร์นี้ด้วยซ้ำ

Apple เองได้แถลงผ่าน TechCrunch ว่า ได้ตัดสินใจชะลอ และเลื่อนการเปิดใช้ฟีเจอร์ CSAM ออกไป โดยจะปรับปรุงประสิทธิภาพและการทำงานให้รัดกุมขึ้น โดยเฉพาะฟีเจอร์ที่เกี่ยวข้องกับความปลอดภัยของเด็ก ๆ

อย่างไรก็ตาม ในแถลงของ Apple ไม่ได้ระบุว่าจะเลื่อนปล่อยฟีเจอร์นี้ไปอยู่ในช่วงไหน และจะยังถูกปล่อยออกมาอยู่หรือไม่ สามารถอ่านข้อมูลเกี่ยวกับ CSAM ได้ที่นี่ : https://www.iphonemod.net/apple-announce-child-safety.html

ที่มา – iclarified